共计 1414 个字符,预计需要花费 4 分钟才能阅读完成。

在近日举行的 QCon AI NY 2025 大会上,资深技术专家 Tracy Bannon 发表了重磅主题演讲,深入探讨了 AI 智能体 的迅速普及如何重塑软件系统,并发出严厉警告:若企业将所有“AI”或“智能体”混为一谈,可能会重蹈过往的 软件架构 覆辙,陷入“架构健忘症”的泥潭。

Bannon 指出,当前业界的许多混淆源于将行为模式与风险特征迥异的技术归入同一标签。例如,机器人 通常被定义为按预设脚本响应、对特定触发条件作出反应的程序;助手 则强调与人类协作,且主导权仍在人类手中。而真正的 智能体 则是目标驱动的自主执行者,能够跨系统做出决策并采取行动。清晰区分这三者是构建稳健 AI 系统 的第一步。

人人都在谈论 AI 的‘生产力’,却鲜少提及随之而来的架构健忘症。—— Tracy Bannon

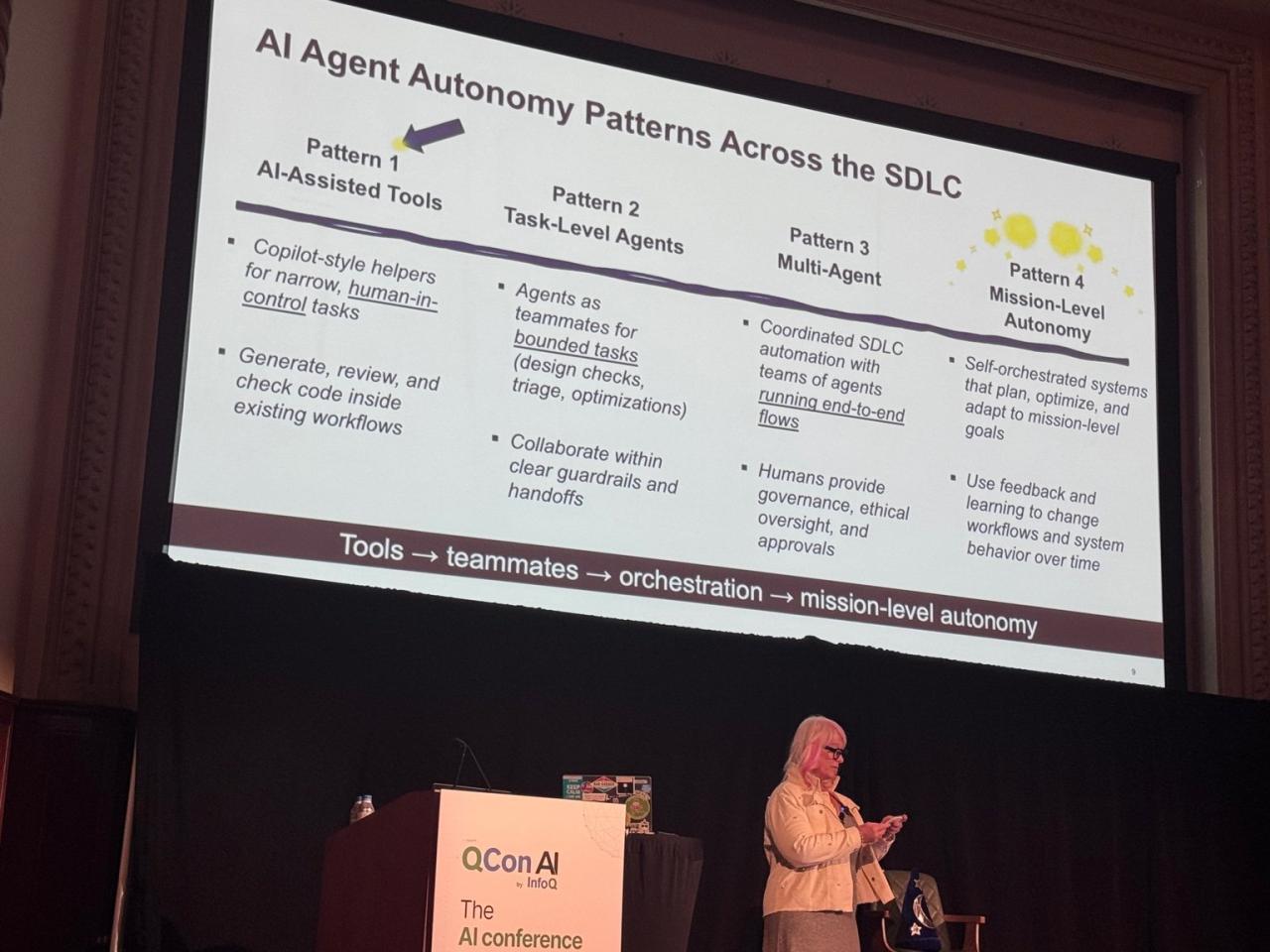

为具体说明,Bannon 梳理了贯穿 软件开发生命周期 的一系列常见自主性模式。这些模式构成了一个从辅助到完全自主的连续谱系:

- AI 辅助工具:嵌入现有工作流,提供建议但不自主行动。

- 任务级智能体:在限定范围内运行,完成特定任务。

- 多智能体编排:协调多个智能体完成端到端流程。

- 使命级自主系统:能实现系统规划、优化与自适应的高阶目标。

演讲的核心论点是:自主性本身并非失败之源;失败发生在自主性增长速度远超 架构规范 发展之时。Bannon 将这种差距导致的现象称为“智能体债务 ”。她将其与几个常见问题领域联系起来:身份与权限泛滥、隔离与管控不足、溯源与可观测性缺失、验证与安全检查薄弱。这本质上是 技术债务 在 AI 时代的新形态。

Bannon 进一步将这一风险置于更广泛的行业趋势中审视,指出研究显示绝大多数技术决策者预计,受 AI 驱动 的复杂性影响,技术债务 的严重程度将在短期内上升。她认为,AI 并未创造全新的故障模式,而是通过加速变革、扩大错误影响范围,加剧了既有问题。

那么,如何应对这一挑战?Bannon 重点阐述了如何将成熟的 架构原则 应用于智能体系统。她主张,组织早已掌握分布式系统的风险管理方法,但在追求快速推进的压力下常常遗忘这些经验。在此背景下,治理机制 被视为建立信任所需的最低控制标准,其核心包括明确的责任界定以及行动与数据流的可追溯性。

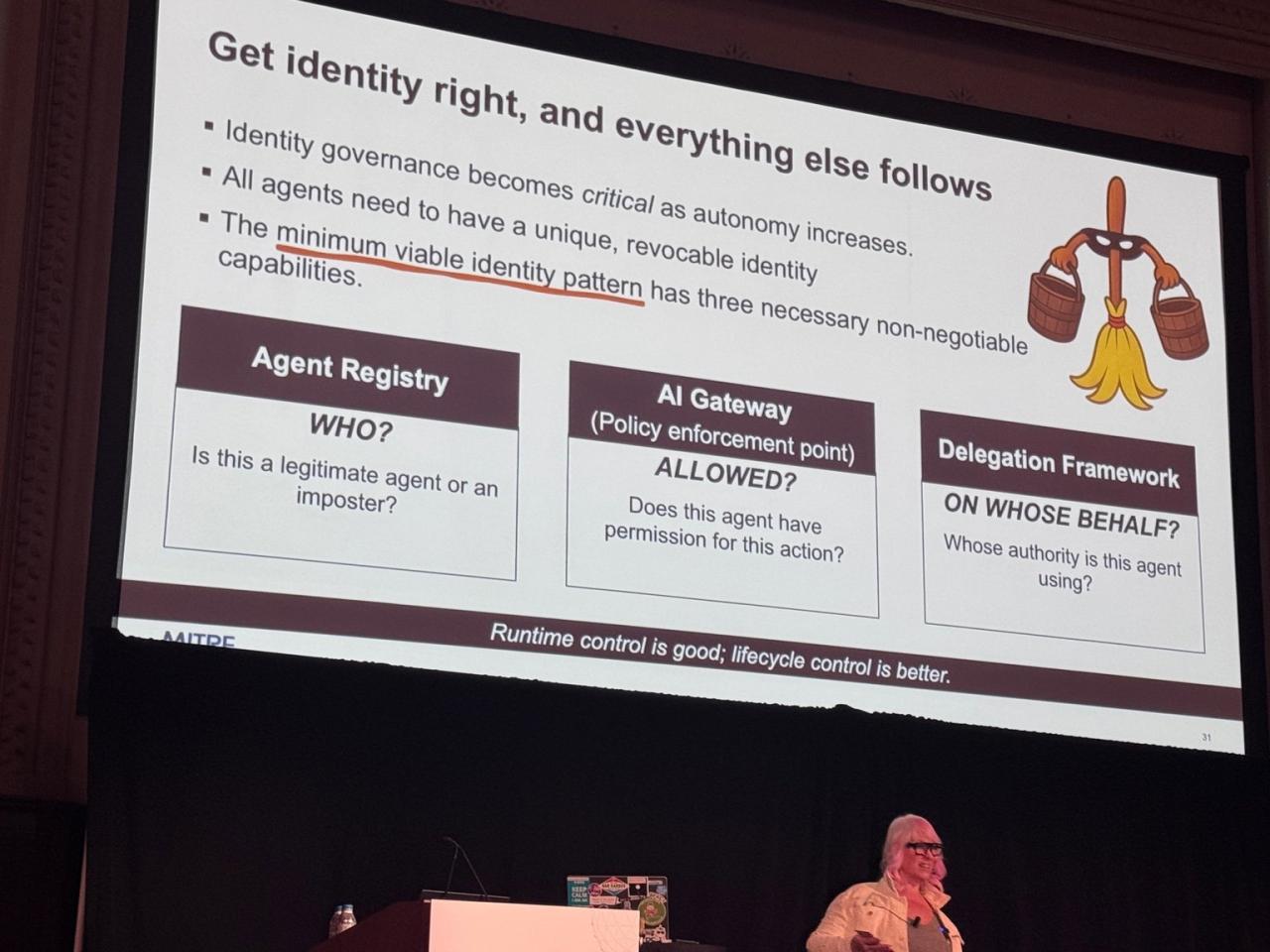

身份识别 被强调为其他所有安全保障所依赖的基础控制层。Bannon 提出,每个智能体都必须具备唯一且可撤销的身份标识,当出现问题时,组织应能迅速回答几个基本问题:智能体可访问哪些资源、执行过哪些操作、如何终止其运行。她描述了一种由 智能体注册表 构成的最小化身份实现模式,这是管理 AI 智能体 风险的关键基础设施。

人们追逐显性的活动指标……却悄然忽视了维持系统健康的工作:设计、重构、验证、威胁建模。—— Tracy Bannon

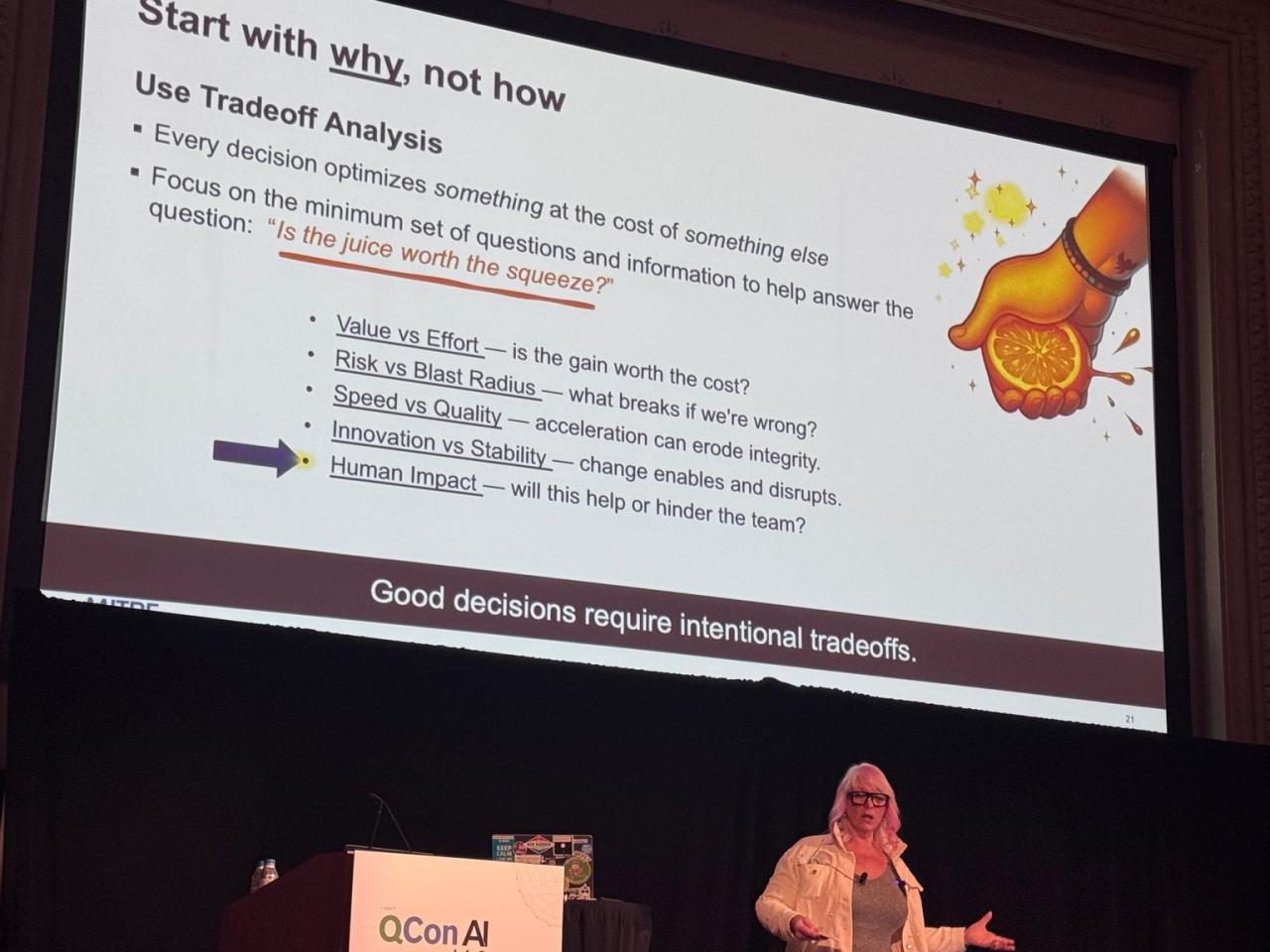

决策规范性 是另一个贯穿始终的主题。Bannon 建议团队应从“为何而做”而非“如何去做”入手,在提升自主性之前明确权衡取舍。她将决策描述为一个始终以牺牲某一维度为代价来优化另一维度的过程,例如在价值与成本、速度与质量之间进行抉择。清晰的决策框架是防止 智能体债务 累积的前提。

演讲最后呼吁架构师与资深工程师在引入 AI 智能体 的过程中发挥更积极的作用。Bannon 将这种责任定义为:通过设计受治理的智能体而非临时自动化方案,来预防 架构健忘症 ;使风险与债务显性化;并仅在明确能产生价值的领域追求更高层级的自主性。她的结语强调: 软件架构 的核心实践依然有效,真正的挑战并非学习一门全新学科,而是铭记并应用早已掌握的原则,在 AI 时代构建既智能又可靠的系统。