共计 2449 个字符,预计需要花费 7 分钟才能阅读完成。

我们正站在一个新时代的门槛上……

周一,OpenAI 首席执行官 Sam Altman 从一个巨大的芒果味果汁盒中喝了一口,并大声评论这个盒子有他一半大小。然而,这并非真实的 Altman,果汁盒也不是真的,他并没有真正说话。这是由 AI 生成的深度伪造视频。最令人担忧的部分是:无法辨别其真实性。

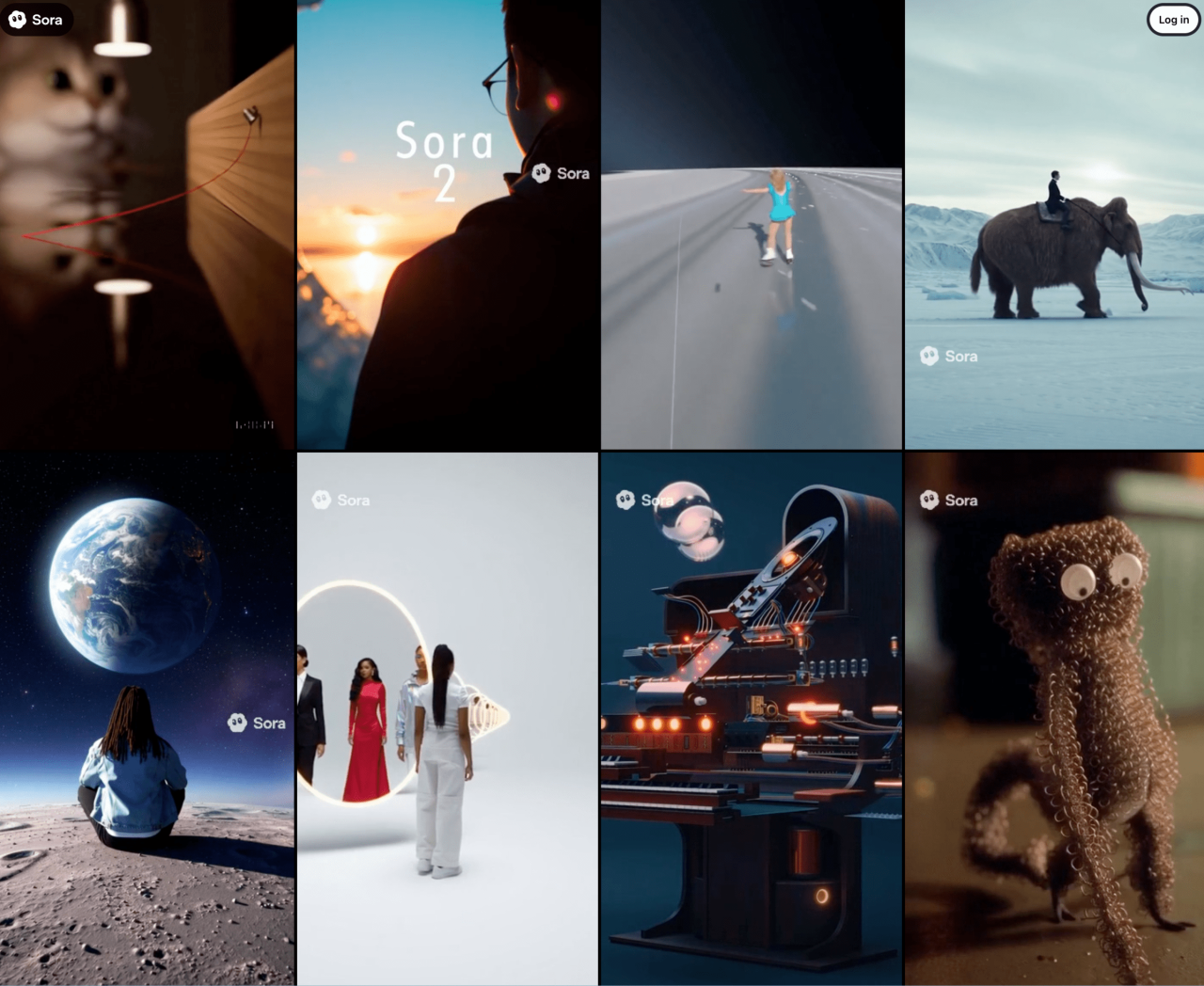

周二,OpenAI 宣布了其新的 AI 视频和音频生成系统 Sora 2,并在周一的记者简报会上,员工称其为“视频生成的 ChatGPT 时刻”。与 ChatGPT 类似,Sora 2 的发布旨在让消费者体验这一新 AI 工具,其中包括一个社交媒体应用,能够生成真实人物说真实话的逼真视频。可以说,这本质上是一个充满深度伪造的应用,而且是故意的。

OpenAI 认为,首次于 2024 年 2 月宣布并于同年 12 月发布的 Sora,终于达到了相对可靠的阶段。OpenAI 的 Sora 负责人 Bill Peebles 将视频生成系统的最早版本比作“老虎机”,用户输入提示后,只能期待输出与所请求的内容有所相似。他表示,新模型“在忠实于用户提示方面要好得多”。

在简报会上,Sora 2 团队表示他们已为此工作了至少 20 个月。该产品的最大变化是现在可以生成与视频同步的音频,不仅是背景音效,还包括适用于多种语言的对话。它可以通过 Sora.com 访问,“Sora 2 Pro 对 ChatGPT Pro 用户开放”,开发者将很快获得 API 访问权限。

该社交应用 也称为“Sora”,现已通过 iOS 在美国和加拿大以邀请制向用户开放。更多国家将陆续推出,每个用户将收到四个额外的邀请码,可以分享给朋友。

在发布中,OpenAI 表示 Sora 2“让我们更接近有用的世界模拟器”。OpenAI 员工告诉记者,新系统在物理方面也更为智能。Peebles 说:“你可以在水面的桨板上准确做后空翻,所有的流体动力学和浮力都准确建模。这确实是该模型在基础物理智能方面的重大进步。”

但这在深度伪造方面也可能成为噩梦,这已经是一个普遍问题。

伴随的 Sora 社交媒体应用看起来很像 TikTok,有“为你推荐”页面和垂直滚动的界面。但它包含一个名为“Cameos”的功能,用户可以通过该应用生成自己的相似视频。在必须在 iOS 应用中录制的视频中,用户被要求朝不同方向移动头部并说出一系列特定数字。一旦上传,用户可以通过文本提示描述所需的视频和音频,将他们的相似视频进行混剪(包括与其他人的相似视频互动)。

OpenAI 员工在周一的简报会上告诉记者,Sora 已经取代了短信、表情符号和语音笔记,成为他们之间交流的主要方式之一。在简报会上,他们展示了用 Sora 2 制作的假广告、两人之间的假对话、假新闻片段等,所有这些内容都通过滚动社交媒体应用来消费。

一些片段是在观看时实时生成的,它们令人毛骨悚然地逼真——不再有六指手(至少在我看到的范围内)。除非视频包含奇幻主题,如巨大的果汁盒示例,否则未经训练的眼睛可能无法辨别这些视频是由 AI 生成的——即使能够辨别,也可能只是基于某种感觉或氛围,觉得有些不对劲。

Sora 应用允许用户选择谁可以创建他们的相似视频:仅自己、自己批准的人、互相关注的人或“所有人”。OpenAI 员工表示,用户是这些相似视频的“共同所有者”,可以随时撤销他人的创建权限或删除包含他们 AI 生成相似视频的视频。也可以在应用中屏蔽某人。团队成员还表示,用户可以在发布前看到他人正在制作的相似视频草稿,未来可能会更改设置,使视频中的人物在发布前必须批准——但目前还不是这样。

在发布中,OpenAI 还提到了其新推出的 家长控制 功能,写道选项包括开启“非个性化推荐流、选择是否允许青少年发送和接收直接消息,以及选择关闭滚动时的不间断内容流”。

与 TikTok 类似,Sora 应用似乎旨在生成社交媒体趋势,能够“混剪”其他视频。目前它生成 10 秒的视频,但 Pro 用户很快可以在网页上获得长达 15 秒的视频,同样的功能将在稍后推出到移动端。员工表示,可以创建更长的视频,但由于这是计算密集型任务,他们仍在研究如何处理。

对于其他人来说,使用 Sora 2 和 Sora 应用的最大任务可能是如何决定什么是真实的。OpenAI 在发布中写道,“每个用 Sora 制作的视频都有多个信号表明它是 AI 生成的”,例如元数据、从 Sora.com 或 Sora 应用下载的视频上的移动水印,以及未指定的“内部检测工具,以帮助评估某个视频或音频是否由我们的产品创建。”(OpenAI 在发布中表示,在某些 ChatGPT Pro 网页流程中,“除非描绘真实人物,否则水印可能会被省略。”)在应用内也不应该进行屏幕录制。但如果最近的历史有任何指导意义,绕过这些限制似乎是不可避免的——就像可能像野火一样传播的错误信息。

至于政府人物、名人和其他公众人物的深度伪造?“公众人物不能在 Sora 中生成,除非他们自己上传了相似视频并同意使用,”OpenAI 在发布中写道。“这适用于所有人:如果你没有上传相似视频,你的相似视频就不能被使用。”OpenAI 员工在简报会上还表示,通过该平台“不可能生成”X 级或“极端”内容,公司目前不允许对 AI 生成的公众人物进行自由文本提示。他们还表示,公司会对视频输出进行审核,以防止潜在的违规行为和版权问题。

但人们过去曾多次绕过此类规则。去年,一位 微软工程师警告 ,其 AI 图像生成器忽略了版权,并通过简单的绕过方法生成了色情和暴力图像。xAI 的 Grok 最近以最少的提示生成了 Taylor Swift 的裸体深度伪造视频。即使对于 OpenAI,员工也告诉记者,公司对公众人物“在这次推出中”是限制性的,似乎不排除未来创建此类视频的可能性。

周一,《华尔街日报》报道,OpenAI 的 Sora 生成 将包含受版权保护的材料,除非版权持有人选择退出其作品出现在平台上。当《The Verge》在周一的 OpenAI 简报会上询问此事时,员工似乎回避了这个问题,指出公司现有的图像生成政策,并表示 Sora 的政策将是其扩展。他们还表示,图像生成版权政策中的一些选择退出将延续,公司将建立更多控制措施。