共计 979 个字符,预计需要花费 3 分钟才能阅读完成。

Nvidia 最新发布的 G -Assist AI 聊天机器人,专为游戏玩家设计,能够在 GPU 上本地运行,帮助用户优化 PC 性能并提升游戏体验。这款实验性产品虽然功能有限,但展示了设备端 AI 的巨大潜力。

G-Assist 集成于 Nvidia 桌面应用程序中,通过浮动覆盖窗口与用户交互。用户可以通过打字或语音与 G -Assist 交流,查看系统状态或调整设置。例如,用户可以询问“DLSS 帧生成是如何工作的?”或要求 AI 调整特定游戏的设置,甚至可以对 GPU 进行超频,并查看预期的性能提升图表。

-

-

Nvidia 去年展示了 G -Assist 的早期版本,其与游戏相关的功能令人印象深刻。该版本能够实时查看用户在游戏中的操作,并提供达成目标的建议。然而,公开版本的游戏集成非常有限,仅支持少数游戏,如《方舟:生存进化》。

尽管如此,G-Assist 支持多个第三方插件,使其能够控制 Logitech G、Corsair、MSI 和 Nanoleaf 等外设。例如,G-Assist 可以与 MSI 主板通信以控制散热配置文件,或与 Logitech G 通信以更改 LED 设置。

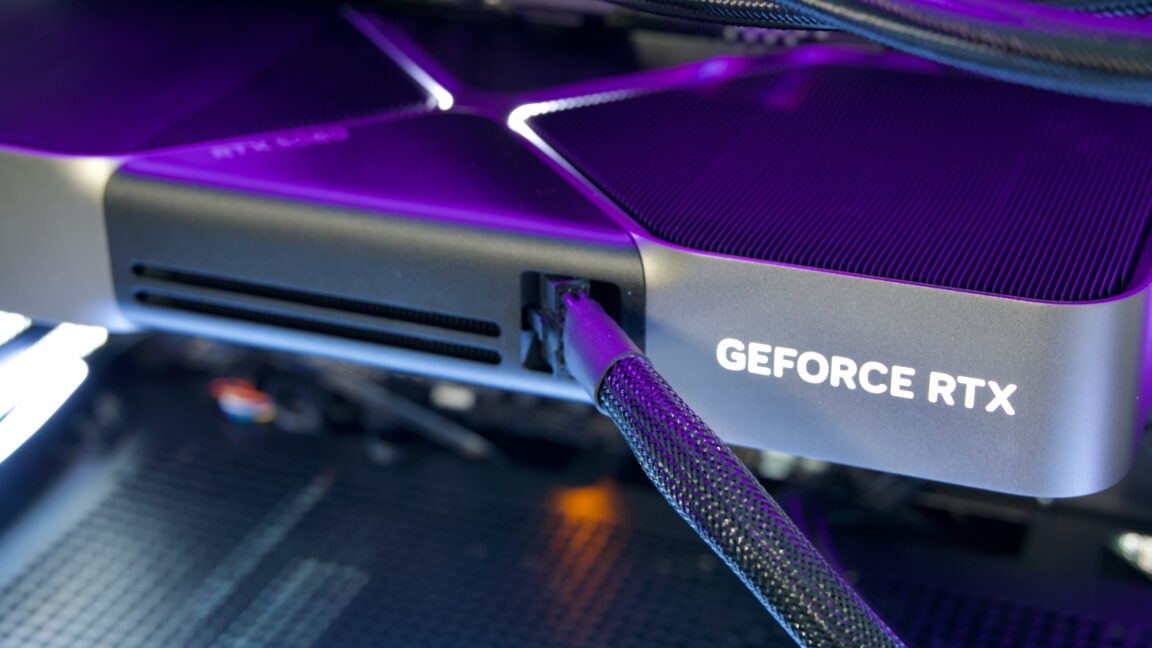

随着 PC 制造商争相发布 AI 笔记本电脑,Nvidia 强调,配备真正 GPU 的计算机才是终极的 AI PC。目前,大多数 AI 工具在云端运行,但 G -Assist 展示了本地 GPU 驱动的 AI 模型的潜力。Nvidia 表示,G-Assist 依赖于一个经过优化的小型语言模型(SLM),专为本地操作设计。默认的文本安装需要 3GB 空间,而添加语音控制后,这一需求将增加到 6.5GB。用户还需要配备至少 12GB 内存的 GeForce RTX 30、40 和 50 系列 GPU。GPU 越强大,G-Assist 运行速度越快。

然而,G-Assist 在 GPU 上运行可能会导致游戏性能下降。在 RTX 4070 上进行的测试显示,与模型交互时 GPU 使用率显著上升,导致《博德之门 3》的 FPS 下降了约 20%。如果用户的 GPU 已经难以维持帧率,G-Assist 将使其更加困难。在游戏之外,G-Assist 的速度要快得多,但如果用户打算经常使用它,则需要非常强大的 GPU。

目前,G-Assist 速度较慢且存在较多问题,用户可能还不想依赖它。手动调整大多数系统和游戏设置仍然更快。然而,这是在硬件上运行 AI 模型的有趣一步。未来的 GPU 可能足够强大,能够同时运行游戏和语言模型,但目前这只是一个有趣的实验。