共计 1959 个字符,预计需要花费 5 分钟才能阅读完成。

那些你永远不会说出口的词语,依然会在大脑语言中枢引发活动。一项最新研究揭示了这一现象,并开发出了一种能够解码内语的脑机接口(BCI)。然而,这项技术也引发了关于心理隐私的深刻担忧。

大多数用于合成人类语音的实验性脑机接口都植入在大脑中负责将说话意图转化为语音肌肉动作的区域。这意味着患者必须实际尝试说话才能使这些植入物工作,这对于严重瘫痪的人来说是相当疲惫的。为了解决这个问题,斯坦福大学的研究人员开发了一种能够解码内语的 BCI——即我们在默读和内部独白中使用的那种语言。问题在于,这些内部独白往往涉及我们不想让别人听到的内容。为了防止他们的 BCI 泄露患者最私密的想法,研究人员设计了一种前所未有的“心理隐私”保护机制。

几乎所有用于语音的神经假体都设计为解码尝试的语音,原因在于最初的想法是尝试与控制人工肢体相同的方法:从负责控制肌肉的大脑区域记录信号。“尝试的动作会产生非常强烈的信号,我们认为它也可以用于语音,”斯坦福大学的神经科学家 Benyamin Meschede Abramovich Krasa 说道,他与 Erin M. Kunz 共同领导了这项研究。

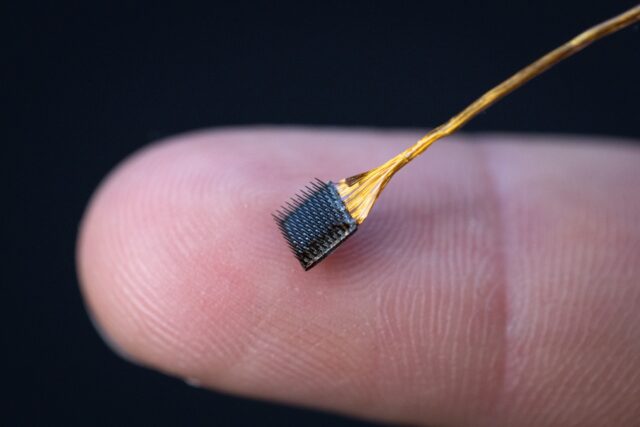

对于患有 ALS 或四肢瘫痪的人来说,尝试说话是一项真正的努力。这就是为什么 Krasa 的团队改变了方向,尝试解码内部或无声的语音,这种语音不会涉及肌肉。这项工作从收集数据开始,以训练 AI 算法,这些算法旨在将涉及内语的神经信号转化为词语。团队与四名几乎完全瘫痪的参与者合作,他们在运动皮层的略微不同区域植入了微电极阵列。他们被分配了一些任务,包括听录制的词语或进行默读。

基于这些数据,团队在负责尝试语音的相同大脑区域的信号中发现了内语的表征。这立即引发了一个问题:一个训练用于解码尝试语音的系统是否有时会意外捕捉到内语。团队用他们之前研究中开发的尝试语音解码系统进行了测试,结果发现它完全可以做到。

直接从我们的思想中提取词语和句子的想法伴随着其公平的隐私担忧——尤其是因为我们对大脑的了解仍然非常有限。早在 2025 年 6 月,当加州大学戴维斯分校展示了一种可以将大脑信号转化为声音的系统时,Ars 询问了领导这项努力的神经假体研究员 Maitreyee Wairagkar,她的 BCI 如何区分内语和尝试的语音。她回答说这不是问题,因为他们记录的是负责控制肌肉的大脑区域的信号。

“公平地说,在他们的研究中没有发生意外的内语解码,”Krasa 说。“但我们有一种预感这可能是可能的,结果确实如此。”因此,他的团队提出了两种不同的保护措施来应对这一问题。

一种针对尝试语音 BCI 的解决方案是自动工作的,依赖于捕捉尝试语音和内语之间的大脑信号的细微差异。“如果你包含内语信号并将其标记为无声,你可以训练 AI 解码神经网络忽略它们——它们在这方面表现得相当好,”Krasa 说。

他们的另一种保护措施则不那么无缝。Krasa 的团队简单地训练他们的解码器识别患者必须想象在脑海中说出以激活假体的密码。密码是什么?“Chitty chitty bang bang”,它就像心理上的“嘿 Siri”。假体以 98% 的准确率识别了这个密码。

一旦心理隐私保护机制到位,团队首先开始测试他们的内语系统,使用提示词语。患者坐在屏幕前,屏幕上显示一个短句,他们必须想象说出它。表现各不相同,在表现最好的患者和 50 个单词的有限词汇量下,准确率达到 86%,但当词汇量扩大到 125,000 个单词时,准确率下降到 74%。

但当团队继续测试假体是否能解码非结构化的内语时,BCI 的局限性变得非常明显。第一个非结构化内语测试涉及观看屏幕上按顺序指向上下左右的箭头。任务是在短暂的延迟后使用操纵杆重复该顺序。预期是患者会在脑海中重复“上、右、上”等顺序以记住它们——目标是看看假体是否能捕捉到它。它确实捕捉到了,但表现仅略高于机会水平。

最后,Krasa 和他的同事尝试解码更复杂的短语,没有明确的提示。他们要求参与者思考他们最喜欢的食物的名称或回忆他们最喜欢的电影台词。“这没有奏效,”Krasa 说。“解码器输出的内容有些混乱。”

在目前的状态下,Krasa 认为内语神经假体是一个概念验证。“我们没想到这会成为可能,但我们做到了,这令人兴奋!不过,错误率太高,无法让某人定期使用它,”Krasa 说。他建议关键的限制可能在于硬件——植入大脑的电极数量以及我们记录神经元信号的精度。内语表征在其他大脑区域可能比在运动皮层更强。

Krasa 的团队目前参与了两个源于内语神经假体的项目。“第一个问题是内语 BCI 与尝试语音替代方案相比有多快,”Krasa 说。第二个项目是研究患有失语症的人,他们可以控制嘴巴但无法产生词语。“我们想评估内语解码是否会对他们有所帮助,”Krasa 补充道。

Cell, 2025. DOI: 10.1016/j.cell.2025.06.015