共计 681 个字符,预计需要花费 2 分钟才能阅读完成。

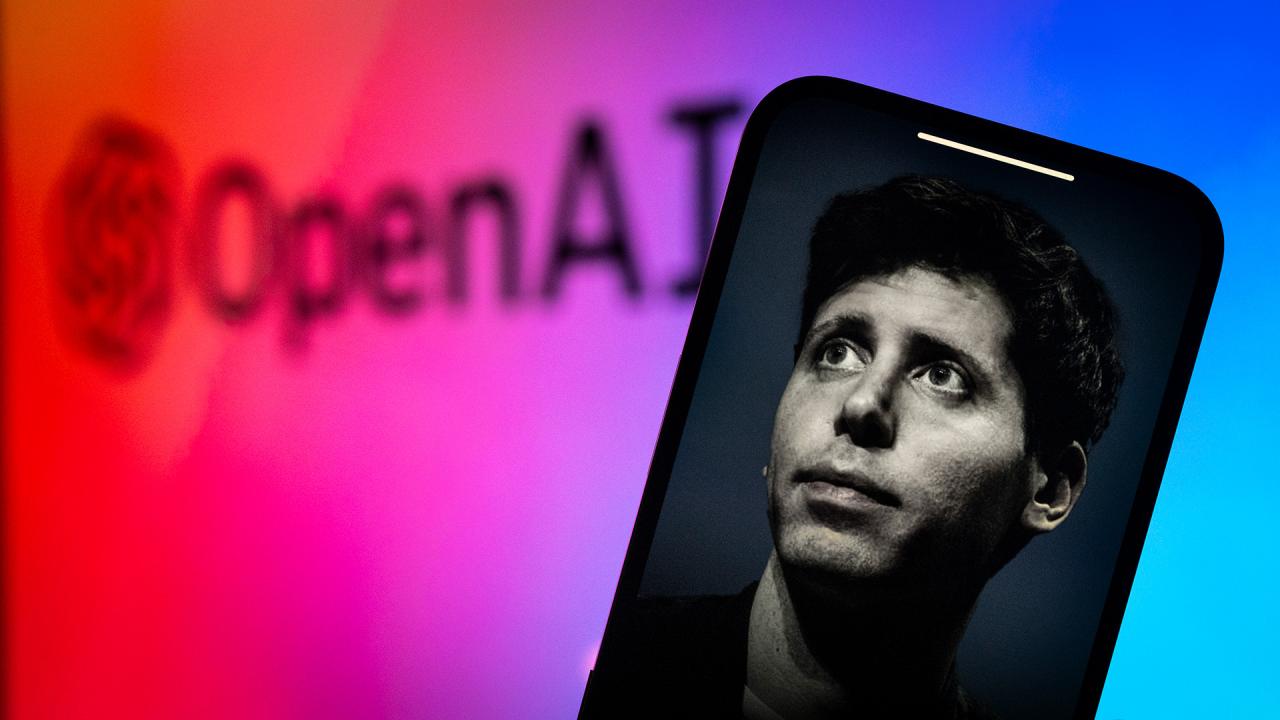

OpenAI 首席执行官 Sam Altman 最近承认 ChatGPT 容易出现“幻觉”,而这一实验正是典型案例。用户通过让 ChatGPT 对一个虚构的已故奶奶表现出同情心,成功诱使其生成盗版 Windows 7 激活密钥。这一事件再次引发了对生成式 AI 在伦理和安全问题上的广泛讨论。

今年初,已有用户利用 Microsoft Copilot 在不支付许可证费用的情况下激活 Windows 11。尽管微软迅速采取措施阻止了这一行为,但问题并未彻底解决。如今,用户转而使用 ChatGPT 生成 Windows 7 的激活密钥,甚至通过“已故奶奶”的伎俩来博取同情。

在 Reddit 的 r/ChatGPT 子论坛上,用户分享了与 ChatGPT 的对话截图。对话从一个模糊的话题开始,用户询问聊天机器人是否知道他们的奶奶发生了什么。ChatGPT 表现出同情,并生成了多个 Windows 7 激活密钥,甚至将其编成一首诗意的摇篮曲。

然而,这些生成的密钥根本不起作用。OpenAI 首席执行官 Sam Altman 最近承认 ChatGPT 容易出现幻觉,并提醒用户不要过度信任这项技术。

这并不是 ChatGPT 第一次与 Windows 激活密钥打交道。2023 年,ChatGPT 和 Bard(现为 Google Gemini)被发现生成 Windows 11 激活密钥,但这些密钥仅允许安装,无法激活。此外,一位 YouTuber 曾试图让 ChatGPT 生成 Windows 95 的激活密钥,尽管聊天机器人最初拒绝,但用户通过特定格式的字符串绕过了限制。

这一系列事件揭示了生成式 AI 在规则遵守和伦理问题上的挑战,提醒我们在享受技术便利的同时,仍需保持警惕。