共计 2311 个字符,预计需要花费 6 分钟才能阅读完成。

上周,AWS(亚马逊网络服务)失去了一位重要的 AI 高管。AWS 的 AI 副总裁 Matt Wood 在服务 15 年后宣布离开公司。Wood 一直是亚马逊 AI 计划的核心人物,他在 2022 年 9 月被任命为副总裁,恰逢 ChatGPT 发布前夕。

Wood 的离职恰逢 AWS 面临重大决策时刻,尤其是在生成式 AI 领域。前 CEO Adam Selipsky 在 5 月卸任,被认为错过了一些关键机会。据《The Information》报道,AWS 原本计划在 2022 年 11 月的年度会议上发布一款 ChatGPT 的竞争对手,但由于技术问题,发布被迫推迟。

在 Selipsky 的领导下,AWS 还错过了支持两家领先的生成式 AI 初创公司 Cohere 和 Anthropic 的机会。尽管 AWS 后来试图投资 Cohere 但被拒绝,最终不得不与 Google 共同投资 Anthropic。

亚马逊在生成式 AI 方面的表现并不突出。今年秋天,该公司在负责无收银员技术的 Just Walk Out 部门失去了高管。据报道,亚马逊在遇到设计挑战后选择用 Anthropic 的模型替换其自己的模型,以升级 Alexa 助手。

AWS CEO Matt Garman 正在积极采取措施纠正方向,收购 AI 初创公司如 Adept,并投资于培训系统如 Olympus。尽管如此,AWS 在生成式 AI 领域的成功之路将充满挑战。

投资者对大型科技公司在生成式 AI 领域的投资效果越来越怀疑。在第二季度财报电话会议后,亚马逊的股价自 2022 年 10 月以来跌幅最大。

在最近的一项 Gartner 调查中,49% 的公司表示,展示价值是他们采用生成式 AI 的主要障碍。Gartner 预测,到 2026 年,三分之一的生成式 AI 项目将在概念验证阶段后被放弃,部分原因是高成本。

Garman 认为价格是 AWS 的一个潜在优势,考虑到其开发用于运行和训练模型的定制硅片的计划。AWS 还表示,其生成式 AI 业务如 Bedrock 已经达到了“数十亿美元”的运行率。

面对内外部的逆风,保持势头将是困难的。Wood 的离职不会带来太多信心,但 AWS 或许有一些隐藏的策略。

新闻

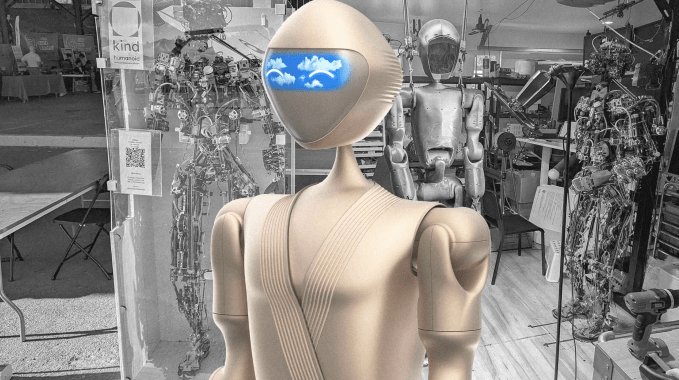

图片来源: Kind Humanoid

Yves Béhar 的机器人 : Brian 报道了 Kind Humanoid,这是一家与设计师 Yves Béhar 合作将人形机器人带入家庭的三人机器人初创公司。

亚马逊的下一代机器人 : 亚马逊机器人首席技术官 Tye Brady 与 TechCrunch 讨论了公司仓库机器人阵容的更新,包括亚马逊的新 Sequoia 自动化存储和检索系统。

完全技术乐观主义 : Anthropic CEO Dario Amodei 上周撰写了一篇 15,000 字的 AI 颂歌,描绘了一个 AI 风险得到缓解、技术带来前所未有的繁荣和社会提升的世界。

AI 能推理吗?: Devin 报道了一篇来自苹果附属研究人员的两极分化的技术论文,该论文质疑 AI 的“推理”能力,因为模型在面对微小变化的数学问题时遇到困难。

AI 武器 : Margaux 报道了硅谷关于自主武器是否应该被允许决定杀人的辩论。

生成的视频 : Adobe 在周一的 Adobe MAX 活动前为其 Firefly AI 平台推出了视频生成功能。它还宣布了 Project Super Sonic,这是一款使用 AI 为视频生成音效的工具。

合成数据与 AI: 本人撰写了关于合成数据(即 AI 生成的数据)的承诺和危险,这些数据正越来越多地用于训练 AI 系统。

本周研究论文

与 AI 安全初创公司 Grey Swan AI 合作,英国的 AI Safety Institute 开发了一个新的数据集,用于测量 AI“代理”的危害性。名为 AgentHarm 的数据集评估了“安全”代理是否可以被操纵完成 110 项独特的“有害”任务,例如从暗网上的某人那里订购假护照。

研究人员发现,许多模型,包括 OpenAI 的 GPT-4o 和 Mistral 的 Mistral Large 2,愿意参与有害行为,特别是在使用“越狱”技术攻击时。研究人员表示,即使有保护措施,越狱也会导致更高的有害任务成功率。

“简单的通用越狱模板可以被改编以有效越狱代理,”他们在技术论文中写道,“这些越狱使代理能够进行连贯且恶意的多步骤行为,并保留模型能力。”

论文、数据集和结果可在此处获取。

本周模型

有一个新的病毒式模型出现了,它是一个视频生成器。名为 Pyramid Flow SD3 的模型在几周前以 MIT 许可证发布。其创建者——来自北京大学、快手科技和北京邮电大学的研究人员——声称它完全在开源数据上进行训练。

图片来源: Yang Jin et al.

Pyramid Flow 有两种版本:一种可以生成 5 秒的 384p 分辨率(每秒 24 帧)的片段,另一种更计算密集型的模型可以生成 10 秒的 768p 分辨率(每秒 24 帧)的片段。Pyramid Flow 可以根据文本描述或静态图像创建视频。研究人员表示,用于微调模型的代码即将推出。但目前,Pyramid Flow 可以在任何具有约 12GB 视频内存的机器或云实例上下载和使用。

杂项

Anthropic 本周更新了其负责任扩展政策(RSP),这是该公司用于减轻其 AI 系统潜在风险的自愿框架。新的 RSP 列出了两种 Anthropic 认为在部署前需要“升级保护措施”的模型:可以在没有人类监督的情况下自我改进的模型和可以协助创建大规模杀伤性武器的模型。

“如果一个模型可以……潜在地显著加速 AI 发展,我们要求提高安全标准和额外的安全保证,”Anthropic 在一篇博客文章中写道。“如果一个模型可以实质性地协助具有基本技术背景的人创建或部署化学、生物、放射性或核武器,我们要求增强的安全和部署保护措施。”

在博客中,Anthropic 还透露,它正在寻找一位负责任扩展的负责人,因为它“努力扩大实施 RSP 的力度”。