共计 579 个字符,预计需要花费 2 分钟才能阅读完成。

Anthropic 近日宣布,将开始利用用户数据训练其 AI 模型,涵盖新的聊天记录和编程会话,除非用户选择退出。此外,该公司还将数据保留期限延长至五年,这一政策同样适用于未选择退出的用户。

所有用户需在 9 月 28 日前做出决定。根据 Anthropic 周四发布的博客文章,选择“接受”的用户,其数据将立即用于模型训练,并保留长达五年。

这一设置适用于“新的或恢复的聊天和编程会话”。即使用户同意 Anthropic 使用其数据训练 AI 模型,也不会涉及之前未恢复的聊天或编程会话。然而,如果用户继续旧的聊天或编程会话,所有数据都将被纳入训练范围。

此次更新适用于 Claude 的所有消费者订阅层级,包括 Claude Free、Pro 和 Max,“包括当他们使用与这些计划关联的账户中的 Claude Code 时,”Anthropic 写道。但该政策不适用于 Anthropic 的商业使用层级,如 Claude Gov、Claude for Work、Claude for Education 或 API 使用,“包括通过第三方如 Amazon Bedrock 和 Google Cloud 的 Vertex AI。”

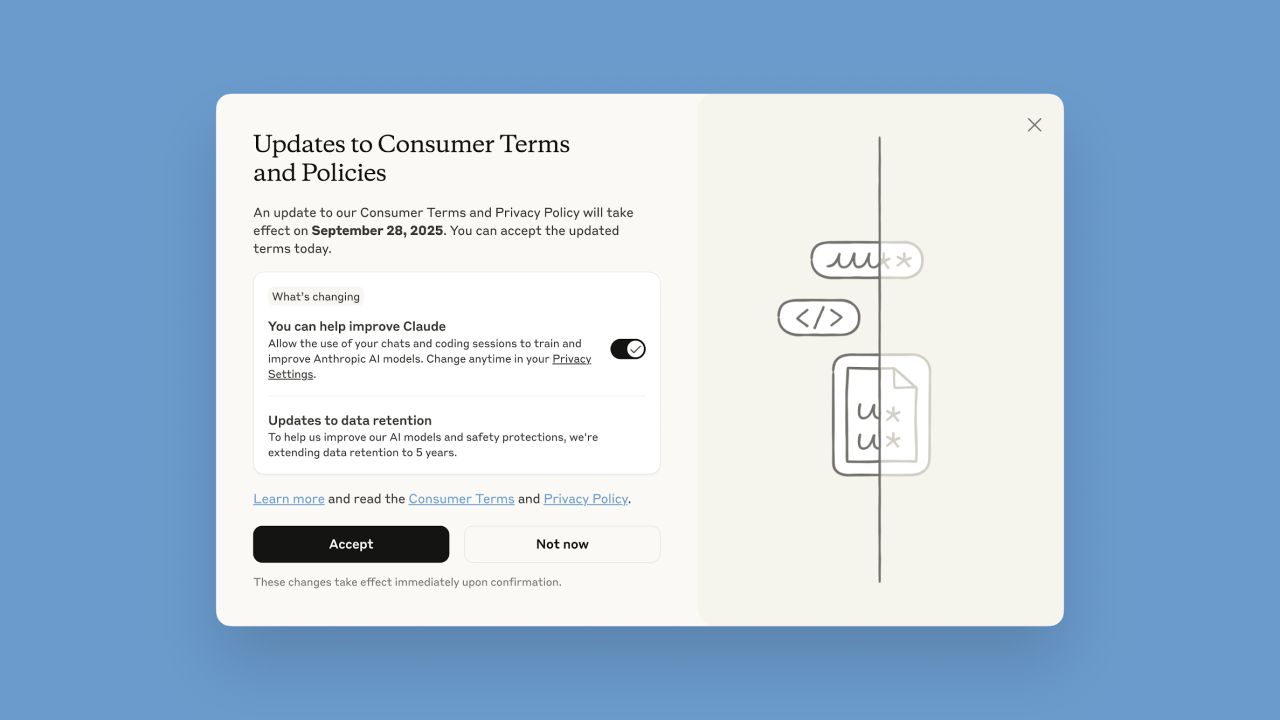

新用户需在 Claude 注册过程中选择其偏好。现有用户则需通过弹窗做出决定,他们可以点击“稍后再说”按钮推迟选择,但最终必须在 9 月 28 日前做出决定。

值得注意的是,许多用户可能会在不阅读内容的情况下迅速点击“接受”。