共计 1698 个字符,预计需要花费 5 分钟才能阅读完成。

2024 年 9 月 5 日,AI 写作初创公司 HyperWrite 的联合创始人兼 CEO Matt Shumer 发布了 Reflection 70B,这是一款基于 Meta 的开源 Llama 3.1-70B Instruct 的新大型语言模型(LLM),采用了创新的错误自我修正技术,并在多个第三方基准测试中表现卓越。

Shumer 在社交网络 X 上宣布,Reflection-70B 目前是全球顶尖的开源 AI 模型。该模型通过 Reflection-Tuning 技术进行训练,旨在使 LLM 能够自我修复错误。下周,他们计划推出 405B 版本,预计将成为全球最佳模型。

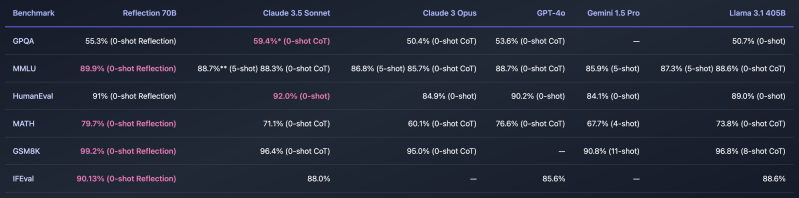

Reflection 70B 在 MMLU 和 HumanEval 等多个基准测试中表现优异,使用 LMSys 的 LLM Decontaminator 确保测试结果的准确性。这些测试表明,Reflection 持续优于 Meta 的 Llama 系列模型,并与顶级商业模型相媲美。

用户可以在一个“游乐场”网站上亲自体验 Reflection 70B,但由于新模型的发布,网站流量激增,团队正在努力获取足够的 GPU 资源以满足需求。

Reflection 70B 的独特功能

Shumer 强调,Reflection 70B 不仅在性能上与顶级模型竞争,还引入了独特的错误识别和修正功能。该模型通过反射调优技术,在最终确定响应之前检测并纠正自己的推理错误。

Reflection 70B 引入了新的特殊标记用于推理和错误修正,使用户能够以更结构化的方式与模型互动。在推理过程中,模型在其特殊标签内输出推理过程,如果检测到错误,可以进行实时修正。

游乐场演示网站提供了用户使用的建议提示,例如询问 Reflection 70B 在单词“Strawberry”中有多少个字母“r”实例,以及哪个数字更大,9.11 还是 9.9。这些简单问题通常是许多 AI 模型难以一致正确回答的。

这使得该模型在需要高精度的任务中特别有用,因为它将推理分为不同的步骤以提高精度。该模型可通过 AI 代码仓库 Hugging Face 下载,API 访问将于今天晚些时候通过 GPU 服务提供商 Hyperbolic Labs 提供。

更强大的模型即将到来

Reflection 70B 的发布只是 Reflection 系列的开端。Shumer 已经宣布,下周将推出更大的模型 Reflection 405B。他还透露,HyperWrite 正在将其主要 AI 写作助手产品集成 Reflection 70B 模型。

预计 Reflection 405B 将超越当今市场上甚至最顶尖的闭源模型。Shumer 还表示,HyperWrite 将发布一份详细介绍训练过程和基准的报告,提供有关驱动 Reflection 模型的创新见解。

Reflection 70B 的基础模型基于 Meta 的 Llama 3.1 70B Instruct,并使用标准的 Llama 聊天格式,确保与现有工具和管道的兼容性。

Glaive 加速 AI 模型训练

Reflection 70B 成功的关键贡献者是 Glaive 生成的合成数据,这是一家专注于创建用例特定数据集的初创公司。Glaive 的平台能够快速训练小型、高度专注的语言模型,帮助实现 AI 工具的民主化。

通过利用 Glaive 的技术,Reflection 团队能够快速生成高质量的合成数据来训练 Reflection 70B。Shumer 感谢 Sahil 和 Glaive AI 平台加速了开发过程,数据在几小时内生成,而不是几周。

HyperWrite 的未来展望

展望未来,Shumer 对 Reflection 系列有更大的计划。随着 Reflection 405B 即将推出,他相信它将显著超越当前全球领导者 OpenAI 的 GPT-4o 等专有或闭源 LLM 的性能。

这对 OpenAI 来说不是好消息,但对其他闭源模型提供商如 Anthropic 甚至微软来说也是如此。在快速发展的生成式 AI 领域,似乎又一次权力平衡发生了变化。

目前,Reflection 70B 的发布标志着开源 AI 的一个重要里程碑,为开发人员和研究人员提供了一个强大的工具,其能力可与专有模型相媲美。随着 AI 的不断发展,Reflection 独特的推理和错误修正方法可能会为开源模型所能实现的目标设定新的标准。