共计 625 个字符,预计需要花费 2 分钟才能阅读完成。

美国联邦调查局(FBI)近日在社交媒体平台 X 上发布了两张模糊的照片,称其为右翼活动家查理·柯克枪击案的嫌疑人。然而,这一举动引发了意想不到的后果:众多网友迅速使用 AI 技术对照片进行“增强”处理,试图将模糊的监控图像转化为清晰的高分辨率照片。尽管这些 AI 工具表面上是为了揭示隐藏的细节,但实际上它们只是在推测可能存在的特征,且有过生成不准确内容的记录。

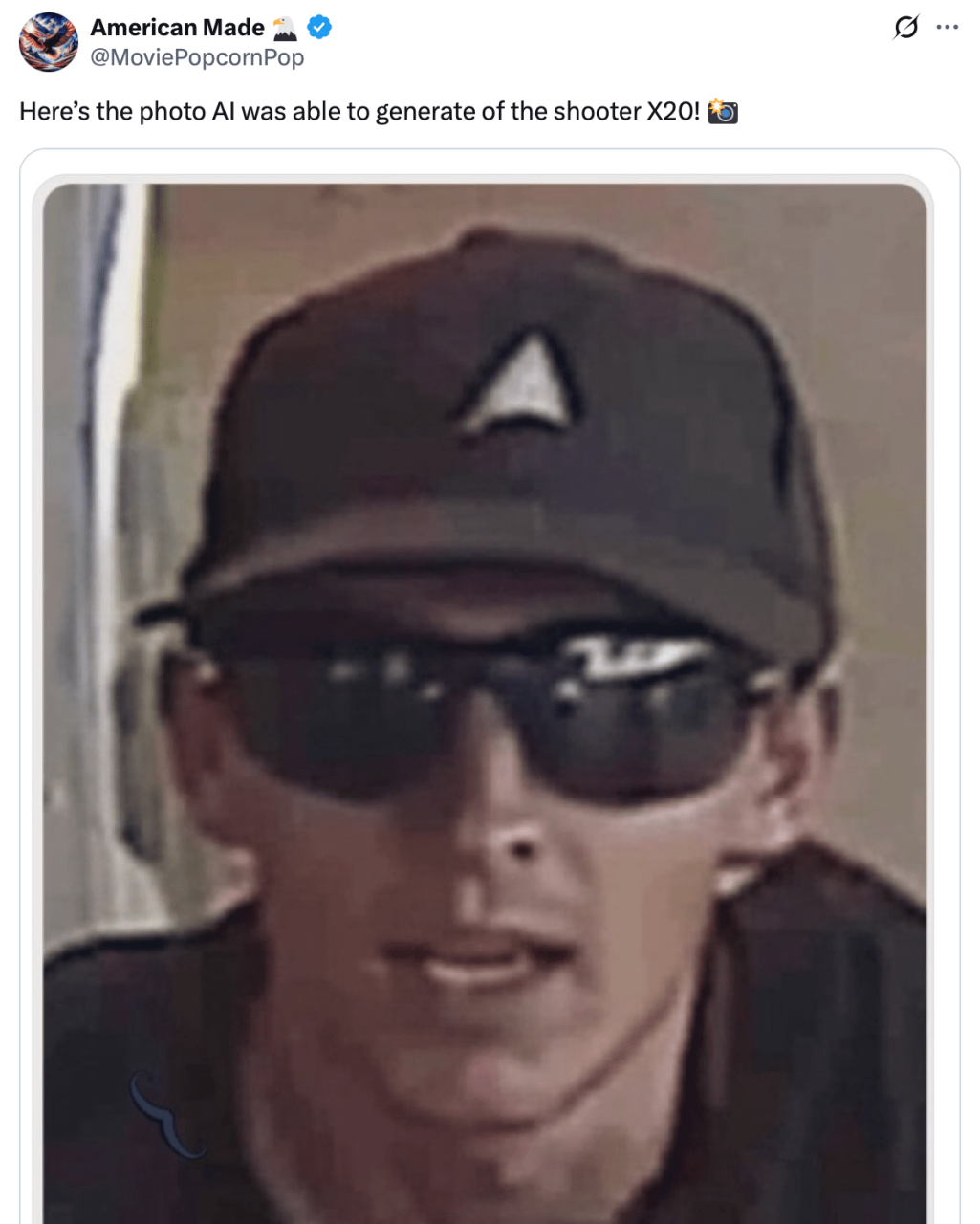

这些 AI 生成的“增强”照片在原始帖子下方大量涌现,部分照片由 X 平台的 Grok 机器人生成,另一些则使用了 ChatGPT 等工具。然而,这些照片的可信度参差不齐,有些甚至明显失真。例如,一张“基于 AI 的文本渲染”照片显示了一件完全不同的衬衫和一个夸张的下巴。尽管这些照片声称是为了帮助公众识别嫌疑人,但实际上它们更像是吸引眼球、获取点赞和转发的工具。

值得注意的是,这些 AI 增强照片很可能并不比 FBI 提供的原始照片更有助于破案。在过去的案例中,AI 技术曾将低分辨率的巴拉克·奥巴马总统照片“去像素化”成一位白人男性,并在唐纳德·特朗普总统的头上添加了一个不存在的肿块。AI 技术通过从现有图像中推断来填补空白,尽管在某些情况下这可能有用,但在追捕嫌疑人时,绝对不应将其视为确凿证据。

以下是 FBI 发布的原始照片,供参考:

以下是部分网友使用 AI 技术“增强”处理后的照片示例:

图片来源:@JohnNosta

图片来源:@kilundeezy

图片来源:@MoviePopcornPop

图片来源:@RealKenWalls